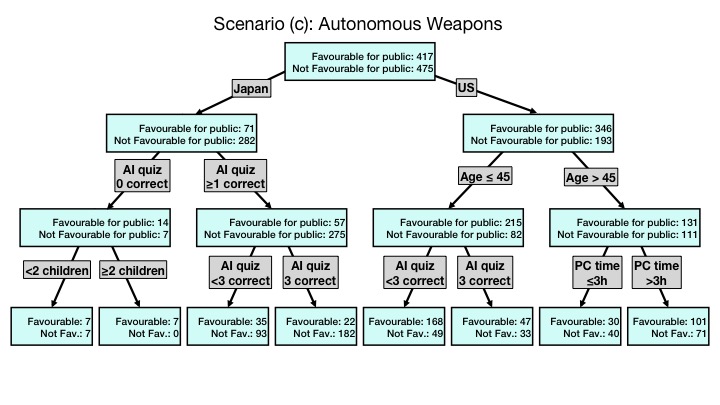

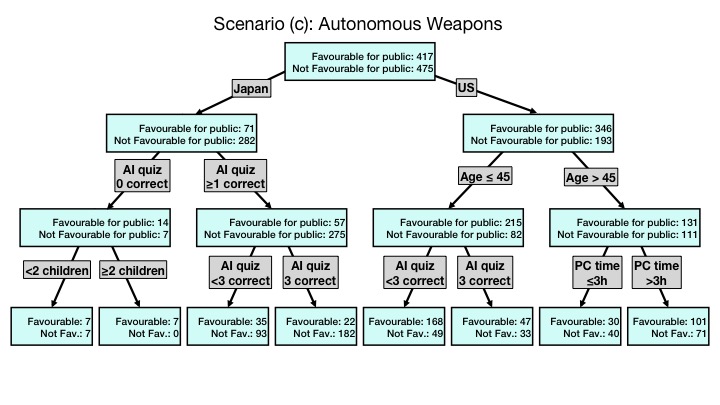

AI兵器のシナリオを読んだ回答者が「公共的な観点からの望ましさ」の項目に対して示した態度の分析結果

AI兵器のシナリオを読んだ回答者が「公共的な観点からの望ましさ」の項目に対して示した態度の分析結果

東京大学 国際高等研究所 カブリ数物連携宇宙研究機構 教授

はい、私たちがScore ELSIを始めたときは、たとえばAIの倫理を数値化するなどの動きは、世界にもほぼなかったと思います。ですから、最初に手をつけられると思いました。個別のケースはそれぞれの議論に文脈があるし、数値化することで大事なことがそぎ落とされる可能性もあり、数値化は難しいと考える研究者が多かったのではないでしょうか。

ELSIを尺度で容易に計測できるようになれば、研究者が事前に自分の研究の倫理課題を確認し、方向性を改めることが可能になります。特定の分野に限定されない、汎用性の高い尺度が開発できれば、倫理的・法的・社会的に大きな問題を抱えるテーマを抽出し、それについて優先的に検討できるようになるでしょう。

また、日本のみならず、国際的に使用可能な尺度にできれば、世界各国のELSIに関する意識の違いを認めた上で議論を展開し、共通のルールを立ち上げることができるようになるはずです。

ELSIが問われる先進的な科学技術は、文脈に依存します。同じ技術でもそれを使う目的や状況によってELSIの判断は変わってくるものです。そこで、科学技術が使われる状況について理解してもらえるように、わかりやすいシナリオを用意し、それを読んだ人々の倫理的・法的・社会的問題に対する反応を測定(点数化)することで、ELSIを数値化・可視化しようと考えました。

まず、先端的な科学技術の代表として、AI(人工知能)技術の倫理的ジレンマをテーマにした4種類のシナリオを用意しました。各シナリオでは、研究者が自分の立場を明らかにした上で、自分が取り組む研究(AI歌手、AI購買促進、AI兵器開発、AI犯罪防止)と、そのメリットとデメリットについて説明してジレンマ状態を提示し、最後に研究継続の可否について人々に問いかけます。

そして、被験者の態度を測定・点数化するための手段として、最初に「オクタゴン尺度」を開発しました1)。オクタゴン尺度とは、ハーバード大学のJessica Fjelds氏らの研究に基づいて開発した指標です。

Fjelds氏らは、国や団体がAIに関して設けている36のガイドラインを分析し、「個人のプライバシー」や「説明責任」、「安全性とセキュリティ」、「透明性と説明可能性」、「公平性と無差別」、「人間による制御」、「専門家の責任」、「人間の価値の促進」という8つの共通要素を抽出しました。オクタゴン尺度では、この8要素が軸に設定されており、一般社会の態度を測定・数値化することが可能になっています。

長くチームを組んでいる一方井祐子先生(金沢大学人間社会研究域人間科学系地域創造学類 准教授)がこの論文をはじめ、ファーストオーサーを務めてくださっています。

1) Y.Ikkatai, T.Hartwig, N.Takanashi & H.M. Yokoyama (2022). 'Octagon Measurement: Public Attitudes toward AI Ethics',International Journal of Human–Computer Interaction https://doi.org/10.1080/10447318.2021.2009669

はい、AIに関する技術であれば、これでかなり網羅できると思います。しかし、オクタゴン尺度はAIのガイドラインをもとに作られたものなので、他の技術に対しての汎用性については、これからさらに検討をしていきます。

私たちはこのほかに、現在議論をされているELSIを念頭に独自のELSI尺度を開発することを思い立ちました。この尺度には、倫理、社会、政策・法律に関連する項目を12項目用意し、それをAIの決定木解析を用いて3つに絞りました。AI倫理をAIで解析するのは、理系出身の学際チームならではでユニークだと思います。社会のELSIへの態度について詳しく調べることができます。

この尺度を用いて、先の4種類のAIシナリオに対する、日本とアメリカの一般社会の態度を測定しました。

はい。下図は、AI兵器のシナリオを読んだ日本とアメリカの回答者の、ELSI尺度の「公共的な観点からの望ましさ」の項目に対する回答を分析した結果です。国の違いが最初の分岐となっていることがわかります。次に、日本の場合はAIに関する知識量、家族の形態(子どもの数)が態度の違いを生み出していることが示されました。

日本とアメリカのすべての結果を解析すると、態度の特徴を分けるのは、まず国、次に年齢、そしてAIに関する知識量であることがわかりました。

AI兵器のシナリオを読んだ回答者が「公共的な観点からの望ましさ」の項目に対して示した態度の分析結果

AI兵器のシナリオを読んだ回答者が「公共的な観点からの望ましさ」の項目に対して示した態度の分析結果

また、この解析を経て、倫理、伝統、政策・法律に関連する項目を、各1つずつに絞り込むことができました2)。具体的には、倫理的問題について「道徳的な正しさ」、社会的問題について「伝統的な観点からの好ましさ」、法的問題群について「政策と法律の整備の状況」を回答者に質問すればよいことがわかったのです。

2) Hartwig, T., Ikkatai, Y., Takanashi, N. & Yokoyama, H.M. (2022). 'Artificial intelligence ELSI score for science and technology: a comparison between Japan and the US'. AI & Soc. https://doi.org/10.1007/s00146-021-01323-9