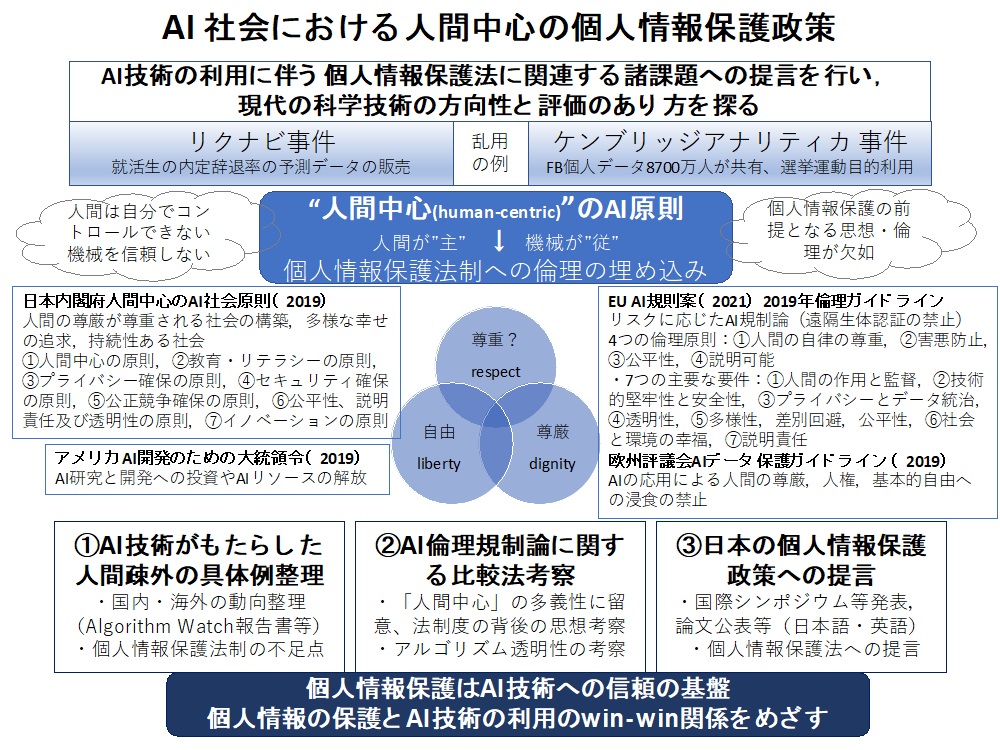

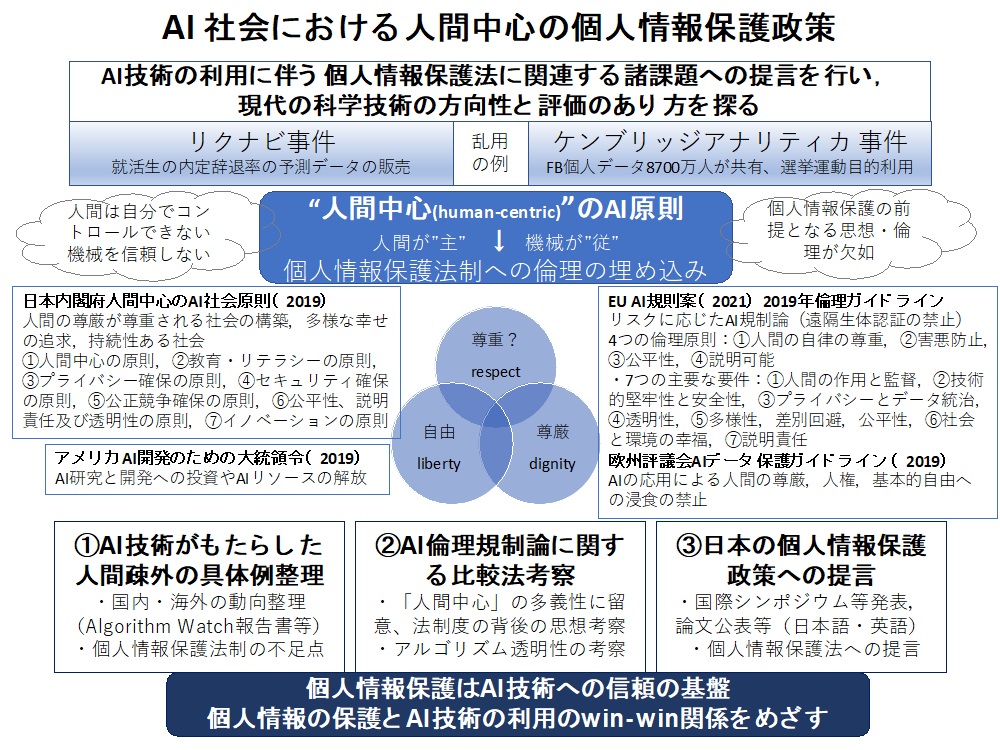

研究の概要。AIの規制ではなく、AI技術をより安全に活用するため、現代の科学技術の方向性と評価のあり方を探ることを目指している

研究の概要。AIの規制ではなく、AI技術をより安全に活用するため、現代の科学技術の方向性と評価のあり方を探ることを目指している

2007年3月一橋大学大学院法学研究科博士課程修了。内閣府事務官(個人情報保護推進室政策企画専門職)、2008年より駿河大学法学部専任講師を務める。2012年ハーバード大学ロースクール客員研究員を経て、2013年より中央大学総合政策学部に准教授として就任。2016年ブリュッセル自由大学ブリュッセルプライバシーハブ研究所、2018年にゲッティング大学法学部にて、客員研究員として研究に従事。2021年に中央大学総合政策学部にて教授となり、現在に至る。

AI社会とは、データの自動処理によって価値を生み出し、それによって社会の利便性や安全性を高めていく社会です。ですが、メリットばかりではありません。個人のプライバシーを侵害し、偏見や差別を助長するといったリスクも存在します。このリスクを排除しなければ、人々は技術を信頼し、安心して活用することができません。プライバシーに関する法的研究は行われていますが、技術の急速な進展に法整備が追いついていない状態です。

そこで本研究では、AI技術がもたらすプライバシーへの脅威を明らかにし、そのリスクを低減させるために「人間中心」という思想について考察し、個人情報保護法に関連する諸課題への提言を行うことで、技術の信頼と安全性を担保することを目的としています。

研究の概要。AIの規制ではなく、AI技術をより安全に活用するため、現代の科学技術の方向性と評価のあり方を探ることを目指している

研究の概要。AIの規制ではなく、AI技術をより安全に活用するため、現代の科学技術の方向性と評価のあり方を探ることを目指している

偶然にも、EUが公表したAI倫理ガイドライン、および日本の内閣府が公開したAI社会原則には、それぞれ「人間中心(human-centric)」という言葉が用いられています。ですが、日本とEUではこの言葉の意味が大きく異なるように思います。

日本にとっての人間中心とは、利便性の高いAI依存からの脱却、人間性の回復という考えです。一方EUにおける人間中心の議論では、人間を「データを生み出す商品」

と捉えることへの抵抗など、哲学者カントの思想に基づく人間の尊厳という価値観に触れることになります。

プライバシーの保護と技術開発の関係に対する、認識の違いです。

たとえば、監視カメラに搭載された自動顔認識機能によって、高い正確性で不審者を検出して自動的にアラートを発信する技術があり、それを駅や空港に設置したとします。

日本では、99%の正確性を有する顔識別カメラもあるため、先端技術の活用で不審者を迅速に発見して安全を確保できるなら、さほど問題視されないでしょう。しかしEUでは、このような監視カメラの導入は原則として禁止される提案がされました。なぜなら、99%の人々の安全が確保されても、1%の人々が誤識別によって不審者に間違われてしまう可能性があるからです。たとえば2019年の成田空港の利用者は約4,434万人、そのうちの1%といえば、約44万人にあたります。つまり、単純計算で44万もの人がテロリストや不法滞在者と誤解され、警備員によって別室に連れて行かれたり、尋問を受けることになってしまいます。

1%の不利益を許容するということは、AI社会からその1%の人々を疎外することになります。EUにとっての人間中心とは、AI社会のためであっても1%の人々の尊厳を犠牲にしない、という思想です。そのため法的根拠なしには、個人がデータ処理が下した決定の客体とはされません。

プライバシーの保護は、技術開発や技術革新の足かせではありません。プライバシーが守られる仕組みがあるからこそ、人々は安心して個人データを提供し、そこから生まれる利便性を安全に享受できるのです。データを扱うビジネスは、この信頼関係の上でなければ成り立ちません。

専門は憲法だったが、アメリカとドイツでそれぞれ1年間ずつ研究していたころ、プライバシーという概念が日本とは全く違う意味で運用されていることに気づき、個人情報の研究を開始した

専門は憲法だったが、アメリカとドイツでそれぞれ1年間ずつ研究していたころ、プライバシーという概念が日本とは全く違う意味で運用されていることに気づき、個人情報の研究を開始した